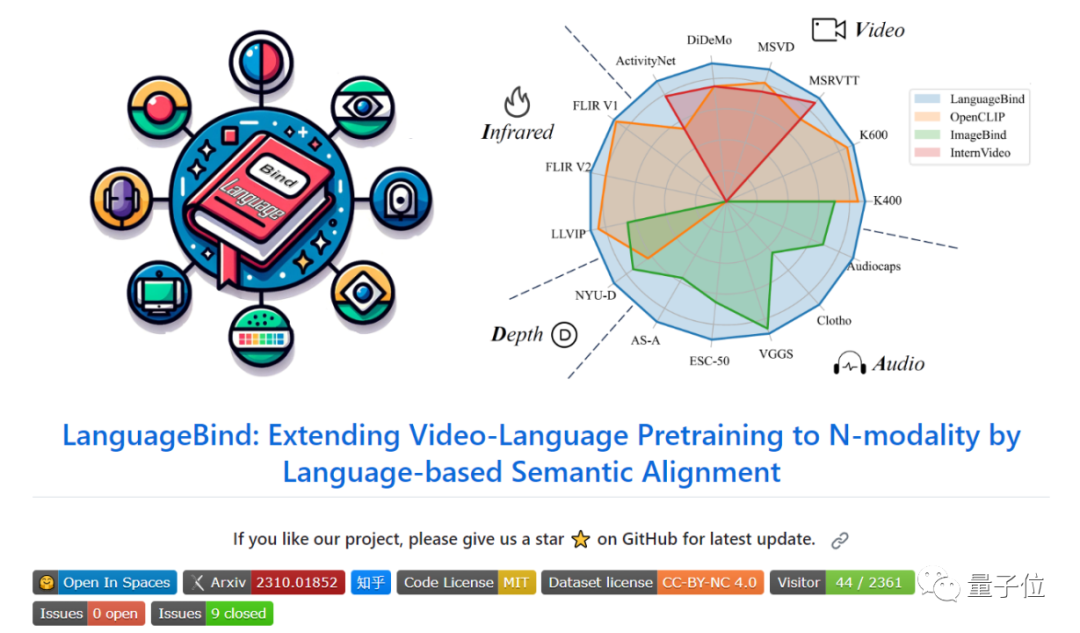

北大 & 腾讯打造多模态 15 边形战士!语言作“纽带”,拳打脚踢各模态,超越 Imagebind

AI4Happiness 投稿 量子位 | 公众号 QbitAI

北大联合腾讯打造了一个多模态 15 边形战士!

以语言为中心,“拳打脚踢”视频、音频、深度、红外理解等各模态。

具体来说,研究人员提出了一个叫做 LanguageBind 的多模态预训练框架。

用语言作为与其它模态之间的纽带,冻结语言编码器,然后用对比学习方法,将各个模态映射到一个共享的特征空间,实现多模态数据的语义对齐。

使用这种方法,模型在 5 个数据集上的性能拿下新 SOTA,在 15 个 zero-shot 检索等任务中取得了显著的性能提升,全面超越 ImageBind、OpenCLIP。

将各模态与语言绑定

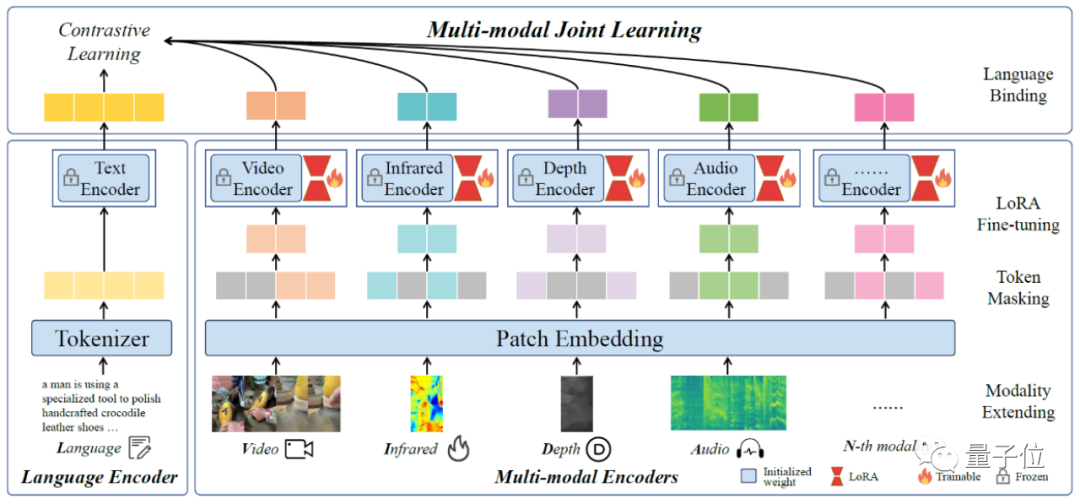

LanguageBind 包含三个部分:

多模态编码器(Multi-modal Encoders),语言编码器(Language Encoder),以及多模态联合学习(Multi-modal Joint Learning)。

先来看多模态编码器部分。

除了语言之外的其它模态,研究人员使用 24 层、1024 维的视觉 Transformer,具有 14 的 Patch 大小。编码器是从 OpenCLIP-large 初始化的。

深度和红外被视为 RGB 图像,在通道维度上复制 3 次与 RGB 图像对齐。

按照 ImageBind 的方式,音频数据被转换为持续 10 秒(128 个 mel-bins)的频谱图,并进行重复和填充。

Patch masking

为了解决在编码器中处理所有 Token 的低效问题,研究人员将图像分成补丁,并通过 Mask 获取一小部分图片序列,按照 MAE 的方法进行。

LoRA fine-tuning

同时使用 LoRA 技术来加速微调。对于具有权重矩阵 W0∈Rd×k 的模态编码器,在学习新的权重矩阵 BA 时,保持权重矩阵 W0 不变。

Modality extending

将 LanguageBind 方法扩展到多个(N 个)模态的第一步是将数据处理成令牌序列。随后,参数将从 OpenCLIP 进行初始化。然后通过令牌屏蔽和 LoRA 微调来训练不同模态的编码器,同时保持语言编码器冻结。最后,将该模态与语言特征空间对齐。

再来看看语言编码器以及多模态联合学习部分。

对于语言编码器,研究人员使用了一个 12 层的 transformer 模型,维度为 768,初始化来源于 OpenCLIP。

对于给定的文本,他们首先使用 BPE 分词器将单词分割成相对常见的子词。每个子词对应一个唯一的标记,这些标记在一个词嵌入层内嵌入。最终,这些标记被语言编码器编码,以获得文本对数:

其中 L 表示序列的长度。为了确保跨不同模态的对齐,研究人员采用了对比学习原则。

这种方法的目标是增加配对数据的相似性,将它们带到相同的语义空间,同时减小不配对数据的相似性。研究人员利用对比学习将各个模态与语言绑定在一起。

构建高质量数据集

此外,研究人员还创建了一个名为“VIDAL-10M”的高质量数据集,其中包含 1000 万个具有对齐视频-语言、红外-语言、深度-语言、音频-语言的数据对,是第一个具有深度和红外模态的大规模视频多模态数据集。

数据集构建方法如下:

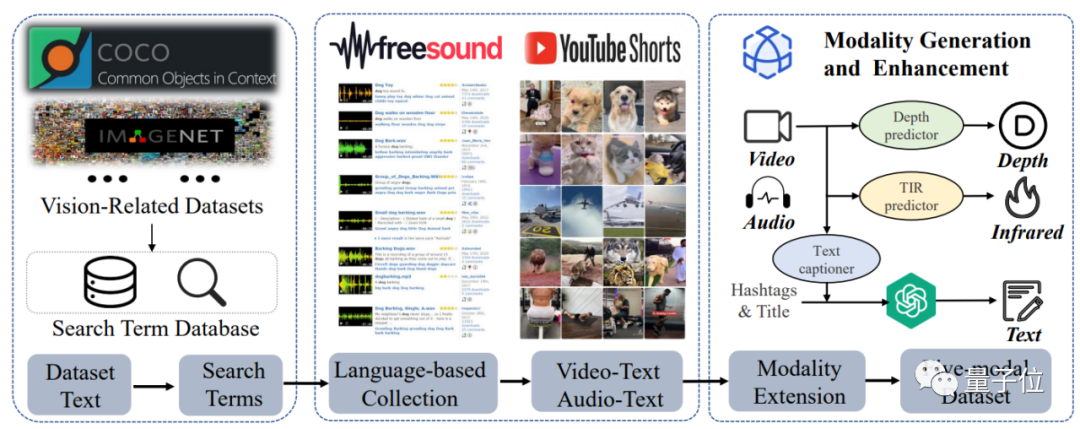

△VIDAL-10M 构建框架

第一步是生成搜索词数据库,这个过程中,研究人员设计了一种独特的搜索词获取策略,利用来自各种视觉任务数据集的文本数据,包括标签和标题,以构建具有丰富视觉概念和多样性的视频数据集。

第二步是从互联网收集相关视频和音频,并进行一系列过滤处理,以确保数据集的质量和准确性。

这个过程中,研究人员使用了多种过滤方法,包括基于文本的过滤、基于视觉与音频的过滤,以确保数据集中的视频和音频与搜索词相关且质量高。

第三步是进行红外和深度模态生成,以及多视角文本生成和增强。

在空间信息增强方面,研究人员采用了 OFA 模型生成多个关键帧描述,以提升视频内容的空间表达质量。

同时,在时间信息增强方面,将视频内容、标题以及 Hashtag 标签输入到 mPLUG-owl 模型中,以获取更为精炼和丰富的时间维度描述。

最后,研究人员运用 ChatGPT 模型对文本描述进行进一步细化和增强。

综合而言,多视角文本增强涵盖了标题、标签、关键帧描述以及视频描述等多个组成部分,为视频内容提供了全面且详尽的描述。

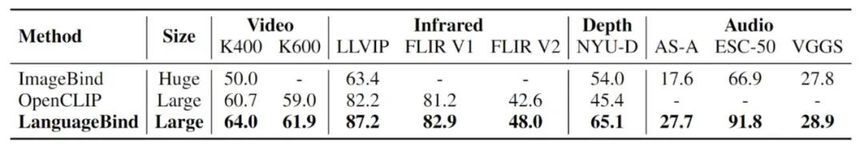

多个测试拿下 SOTA

在测试阶段,大量的实验验证了 VIDAL-10M 数据集和 LanguageBind 方法的有效性,在视频、音频以及其它模态理解任务中取得了显著的性能。

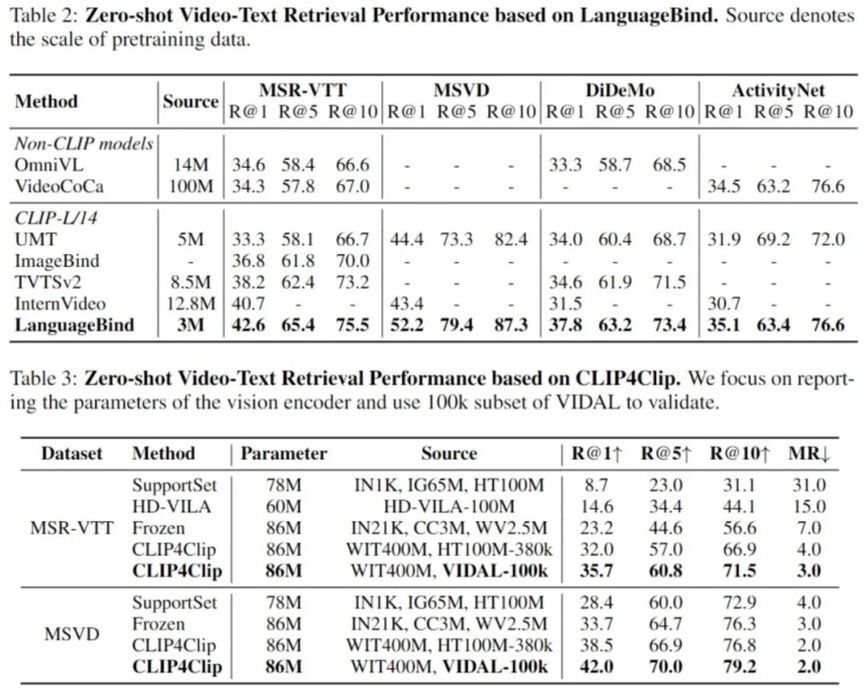

LanguageBind 在四个数据集上都性能拿下 SOTA。

在 MSR-VTT 上比 InterVideo 方法高出 1.9%,在 MSVD 上比 InterVideo 高出 8.8%,在 DiDeMo 上比 InterVideo 高出 6.3%,在 ActivityNet 上比 InterVideo 高出 4.4%。

值得注意的是,InterVideo 采用了更广泛的训练数据,正表明 LanguageBind 的有效性。

△Zero-Shot 视频-文本检索结果

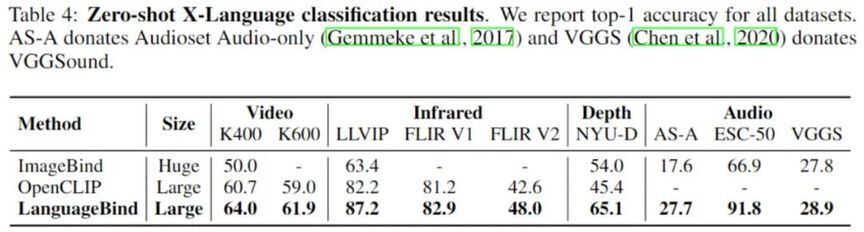

视频-语言、红外-语言、深度-语言和音频-语言 Zero-Shot 分类,在所有数据集上的准确率均优于 ImageBind、OpenCLIP:

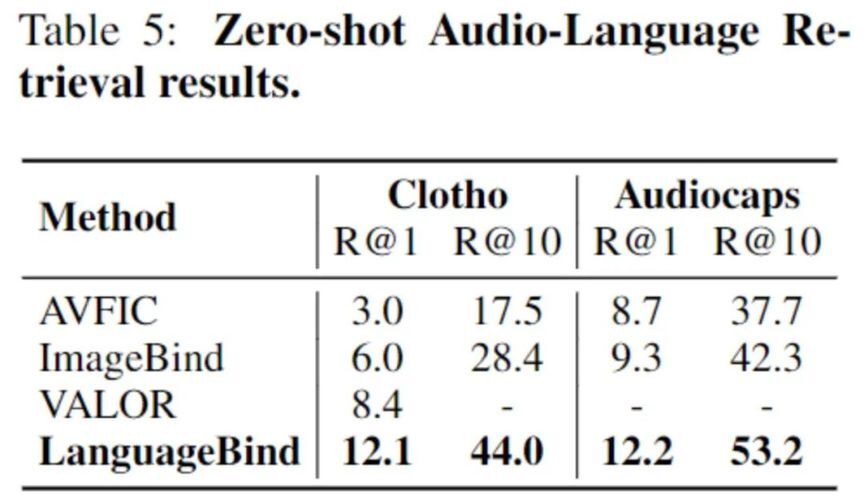

Zero-Shot 音频-语言检索性能同样优越:

评论